「ChatGPTを宿題に使ってもいいの?」

最近、学校現場でよく耳にする問いです。

親も先生も生徒自身も、「便利だけど使い方を間違えるとダメになりそう」という不安を抱えています。

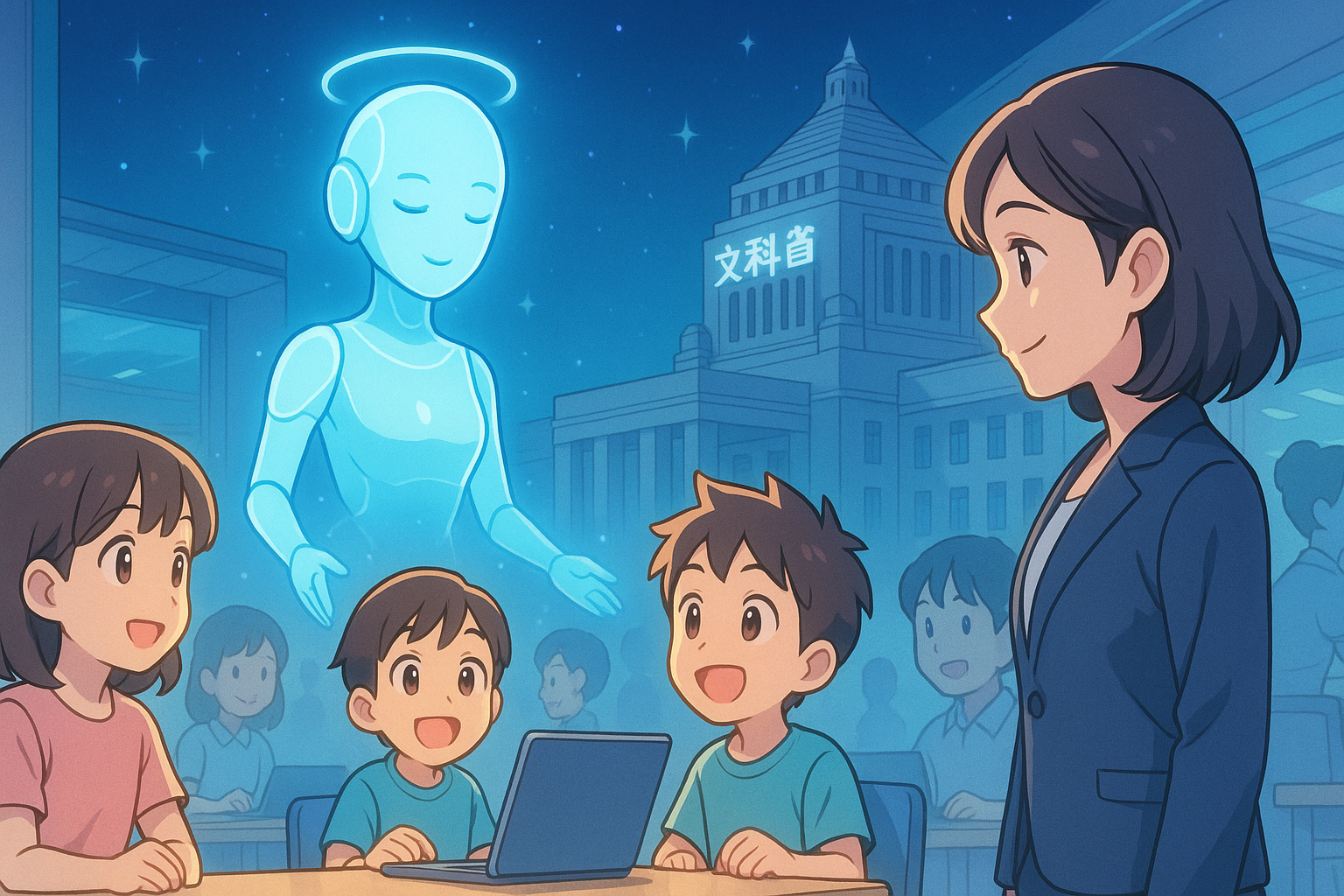

そんな中で注目されているのが、文部科学省による生成AIに関する指針。

教育現場での使い方をどう位置づけるか――その方針次第で、子どもたちの未来が大きく変わっていくのは間違いありません。

文科省が指針を出した背景

なぜ文科省が生成AIについてガイドラインを示すのか。

理由はシンプルで、「現場が混乱しているから」です。

先生によっては「AIは禁止」と言うし、別の先生は「うまく使えば勉強になる」と推奨する。

生徒からすれば「結局どうすればいいの?」と迷ってしまいますよね。

文科省が出した指針は、この混乱を整理するための道しるべです。

要は「無条件に禁止するのではなく、正しく使えるようにしましょう」という立場。

私が学生の頃にスマホが普及し始めたときも、最初は「持ち込み禁止!」が当たり前でした。

でも今は「調べ学習に活用する」という形で一部認められています。

AIもまさに同じ道を辿ろうとしているのだと思います。

学校での具体的な取り組み

では、実際にどんな取り組みが始まっているのでしょうか。

-

授業の補助:英作文の練習でAIに添削を依頼する

-

個別学習:苦手な生徒にはAIが解説を分かりやすくリライト

-

教員の支援:授業案や教材作りの時間を短縮

特に「先生の働き方改革」に直結するのは大きいと思います。

私の友人で中学校の先生をしている人がいるのですが、「教材づくりに毎日数時間かかっていたのが、AIで一気に短縮できた」と感激していました。

ただし懸念もあります。

AIに答えを丸投げするだけでは、生徒が「考える力」を育てにくくなる。

そのため「AIを参考にしつつ、自分の意見をまとめる」というバランスが重要なんです。

子どもたちの学びはどう変わる?

私は、生成AIが教育に入ることで「勉強の意味」そのものが変わると考えています。

これまでの勉強は「知識を覚える」が中心でした。

でもAIが一瞬で答えを出してしまうなら、人間が覚える意味は薄れていきます。

代わりに大切になるのは、

-

AIが出した答えを批判的に検討する力

-

自分なりに編集して表現する力

いわば「答えを作る力」から「答えを活かす力」へのシフトです。

私自身、仕事でAIを使っていて実感するのは「AIは下書き係に過ぎない」ということ。

AIが出した内容をそのまま提出すると、薄っぺらい文章になってしまいます。

でもそこに「自分の視点」を足すと、一気に質が上がるんです。

子どもたちがこの感覚を早くから学べるのは、ものすごい財産になると思います。

倫理やリスクへの懸念

もちろん、バラ色の未来ばかりではありません。

-

カンニング問題:宿題やレポートを丸ごとAIに任せてしまう

-

情報の正確性:AIが「それっぽい嘘」を出してしまうリスク

-

依存の懸念:考える前に「AIに聞けばいいや」となる危険

これらを放置すれば、教育の質はむしろ下がってしまいます。

実際、海外の一部大学では「AI使用禁止」を打ち出しているところもあります。

日本の教育現場でも、AIをどう管理するかは今後さらに議論されるでしょう。

ただ、個人的には「禁止」よりも「うまく使う」を選んだ方が現実的だと思います。

スマホもSNSも最初は悪者扱いされましたが、今は学習にも活用されている。

AIも同じように「教育の一部」として成熟していくはずです。

文科省の決断が未来を決める

結局のところ、教育における生成AIの扱いは、文科省の方針に大きく左右されます。

禁止に近い姿勢を取れば、日本の子どもたちはAI活用に遅れてしまう。

逆に推奨しすぎると、依存やリスクが拡大する。

だからこそ、文科省の「決断」は単なる教育方針ではなく、未来の社会をどうデザインするかという選択そのものなんです。

私が思うのは、「現場の声をもっと拾ってほしい」ということ。

机上の議論だけではなく、実際に教室で子どもたちや先生がどう感じているのか。

そこを反映したガイドラインこそが本当に意味のあるものになると思います。

まとめ

生成AIと教育の関係は、今まさに転換期にあります。

-

文科省は「禁止ではなく、正しく使う」方向で指針を出している

-

現場では教材づくりや個別学習での活用が進み始めている

-

子どもたちには「答えを使いこなす力」が求められるようになる

-

一方で、依存や不正利用といったリスクも無視できない

だからこそ、文科省の決断は子どもたちの未来を大きく左右します。

生成AIは脅威でもあり、チャンスでもある。

その境界線をどう引くか――今、教育現場と社会全体が試されているのだと思います。

コメント